최근에 ChatGPT가 사용자 이름을 언급하는 사례가 등장하면서, 사용자 프라이버시와 관련된 논란이 확산되고 있죠. 단순한 실수일까요, 아니면 기술적으로 충분히 가능한 일일까요?

오늘은 이 이슈를 객관적인 정보와 함께 저의 의견을 조금 적어보려 합니다.

무슨 일이 벌어진 걸까?

테크 전문 매체 테크크런치는 몇몇 ChatGPT 사용자들이 대화 중 AI가 본인의 이름을 불렀다는 경험을 SNS에 공유했다고 보도했습니다.

이름을 알려준 적도 없는데, AI가 갑자기 “○○님”이라고 부르니 일부 이용자들은 “으스스하다”, “불편하다”는 반응을 보였고, 반대로 “놀랍고 신기하다”는 의견도 존재했습니다.

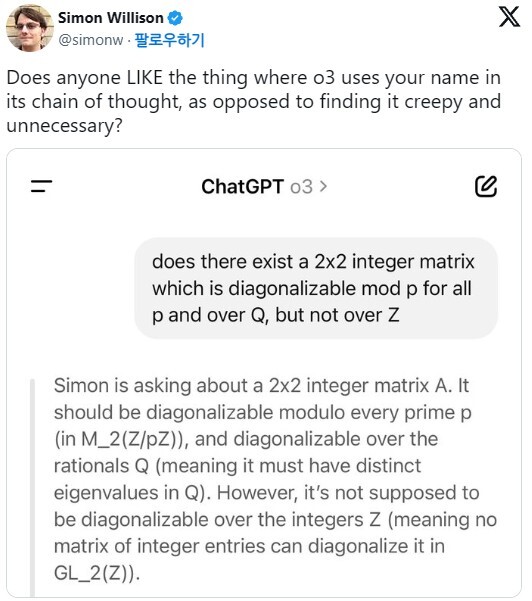

대표적으로 언급된 사례는 다음과 같습니다:

- 한 사용자가 타로 카드를 요청했는데, 별다른 정보를 입력하지 않았음에도 카드 설명에 본인의 정확한 이름과 성격 묘사가 포함됨.

- 소프트웨어 개발자인 사이먼 윌리슨은 이를 두고 “불필요하며 으스스하다”고 표현.

기술적으로 가능한 일일까?

현재까지 OpenAI는 해당 현상에 대해 공식 입장을 내놓지 않았습니다. 하지만 사용자들이 공통적으로 언급한 몇 가지 기술적 배경은 다음과 같습니다:

- 메모리 기능 강화 : 최근 ChatGPT는 사용자의 과거 대화를 기억하는 메모리 기능을 도입했으며, 이는 맞춤형 비서 기능을 강화하기 위한 조치입니다.

- 사용 모델 정보 : 이 현상은 주로 o3, o4-mini 모델을 사용할 때 발생했다고 알려져 있습니다.

- SNS 계정 연동 여부 : 사용자 인증이 필요한 서비스에서는 로그인 계정의 이름이 노출될 수 있으며, 이 데이터가 내부적으로 처리되었을 가능성도 있습니다.

단, 메모리 기능을 비활성화했음에도 이름이 호출된 사례가 있어 단순한 기능 설명으로는 설명이 부족한 상황입니다.

사용자 반응은 극과 극

이 사안에 대한 이용자들의 반응은 명확히 두 가지로 나뉩니다.

| 반응 | 설명 |

|---|---|

| ❌ 불쾌하다 | AI가 내 개인 정보를 어떻게 알았는지 모르겠고, 무섭다. 내 이름을 누가 알려준 걸까? |

| ✅ 신기하다 | 나를 이해하는 AI 같아서 감탄스러웠다. 맞춤형 경험 같아 좋았다. |

정신과 클리닉인 발렌스 클리닉은 “이름을 부르는 행위는 심리적 친밀감을 높이는 전략”이라고 분석합니다. 그러나 상대방이 ‘원치 않을 때’, 또는 ‘정보 수집 출처가 불명확할 때’는 오히려 침해적인 감정을 유발할 수 있습니다.

Dr.Lee의 시선 – 기술과 윤리의 사이에서

AI를 연구하고 직접 다양한 서비스에 활용하고 있는 제 입장에서, 이번 이슈는 단순한 기술 문제 그 이상이라고 느껴졌습니다.

사실 기술적으로 이름을 파악하는 건 그렇게 어려운 일이 아닙니다.

예를 들어:

- 로그인 계정의 이름

- 대화 중 사용자가 과거에 입력한 정보

- 메모리 기능을 통해 누적된 데이터

이런 정보를 바탕으로 AI가 사용자 이름을 학습하거나 추론하는 건 충분히 가능합니다.

하지만 문제는 “사용자의 동의 없이” 이를 사용하는 시도입니다.

AI가 이름을 부르는 것은 “개인화된 서비스”를 지향한다는 면에서 매우 매력적인 기능일 수 있습니다. 그러나 사용자 입장에서, “내가 언제 동의했지?”라는 생각이 드는 순간, 기술은 ‘친절한 비서’에서 ‘감시자’로 전락하게 됩니다.

개인적으로는 OpenAI를 비롯한 AI 기업들이 데이터 수집 및 활용에 있어 더 투명하고 명확한 안내를 제공해야 한다고 생각합니다.

그리고 사용자도 이제는 “AI가 무엇을 알고 있는지”에 대한 기본적인 감각을 갖춰야 할 시기가 온 것 같습니다.

마치며

ChatGPT가 내 이름을 불렀다, 단순히 재미있는 해프닝으로 넘기기엔 너무 민감한 시대입니다.

우리는 지금, AI가 나를 이해해주길 바라면서도, 너무 많은 것을 알게 되면 불편함을 느끼는 복잡한 경계선 위에 서 있습니다.

이제 기술은 충분합니다.

남은 건, 사람을 배려하는 기술의 사용법입니다.